Ať dnes otevřeme jakékoli médium, téměř jistě najdeme nějaký článek, který se alespoň lehce dotýká umělé inteligence (AI). Témata jsou v podstatě podobná a oscilují mezi bezbřehým optimismem („se vším nám pomůže") a totálním pesimismem („všechny nás zotročí"). V posledních lednových dnech letošního roku se však články o AI stočily k novému tématu.

Hlavním „hrdinou" posledních týdnů je čínský LLM (large language model) DeepSeek R1 vyvíjený společností DeepSeek AI. Podle oficiálních sdělení a prvního zkoumání je tento model téměř stejně efektivní jako ChatGPT od OpenAI. To by ještě nebylo tak neobvyklé, přece jenom můžeme říci, že obecný princip trénování LLM je známý a záleží „jenom" na tréninku, datech a výpočetní kapacitě.

Co tedy bylo na tomto oznámení jiné?

A strhla se bouře

DeepSeek AI zároveň uvedla, že je její model levnější, byl vytrénován za velmi nízkých nákladů (v porovnání s OpenAI) a na slabším hardwaru, který nepodléhá omezením USA. V reakci na toto oznámení klesly během dne akcie velkých technologických firem o více než 10 %. Například Nvidia, stěžejní výrobce čipů mimo jiné právě pro AI, odepsala za jediný den 583 miliard USD (rekord v rámci burzy na Wall Street).

Podobně dopadly akcie dalších firem včetně OpenAI. Ale proč vlastně? Dokázala DeepSeek AI skutečně vytvořit výkonný model s velmi nízkými náklady?Cenová analýza

Zjednodušíme si situaci a podíváme se jenom na srovnání ChatGPT a DeepSeek. Pro nasazení AI jako služby potřebujeme tokeny, tedy „mince" na jednotlivé akce. Oba modely tedy nabízejí určitý kurz hodnoty USD a milionu tokenů (rozdílná je cena za vstup a výstup).

[Tokenem zpravidla označujeme nedělitelné jednotky textu při zpracování přirozeného jazyka, lexikální analýze programovacího jazyka nebo práci s datovými formáty. S příchodem decentralizovaných databází, tzv. blockchainu, a kryptoměn se z tokenu, jakožto jednotky zpravidla složené nejen z jejího obsahu, ale i řadového čísla, popřípadě jiných údajů zapsaných do blockchainu pomocí takzvané ražby (v angl. minting), stala i pojistka záruky obsahu a v konečném důsledku i platidlo - pozn. red.]

Cena je pro zájemce významným rozhodovacím prvkem, který hraje roli při výběru modelu. Obě společnosti mají více modelů, postavíme-li proti sobě srovnatelné, vyjde nám následující tabulka:

|

Model |

Vstup |

Výstup |

|

ChatGPT 4 |

$2,5 |

$10 |

|

DeepSeek V3 |

$0,14 |

$0,25 |

|

Rozdíl |

94 % |

98 % |

|

|

|

|

|

ChatGPT o1 |

$15 |

$60 |

|

DeepSeek R1 |

$0,55 |

$2,19 |

|

Rozdíl |

96 % |

96 % |

Zároveň je možné DeepSeek R1 stáhnout na GitHubu v rámci licence MIT a rozběhnout jej na vlastních serverech. Je možné jej tak využívat na vlastním hardwaru a vyvíjet na něm vlastní služby.

Kvalita

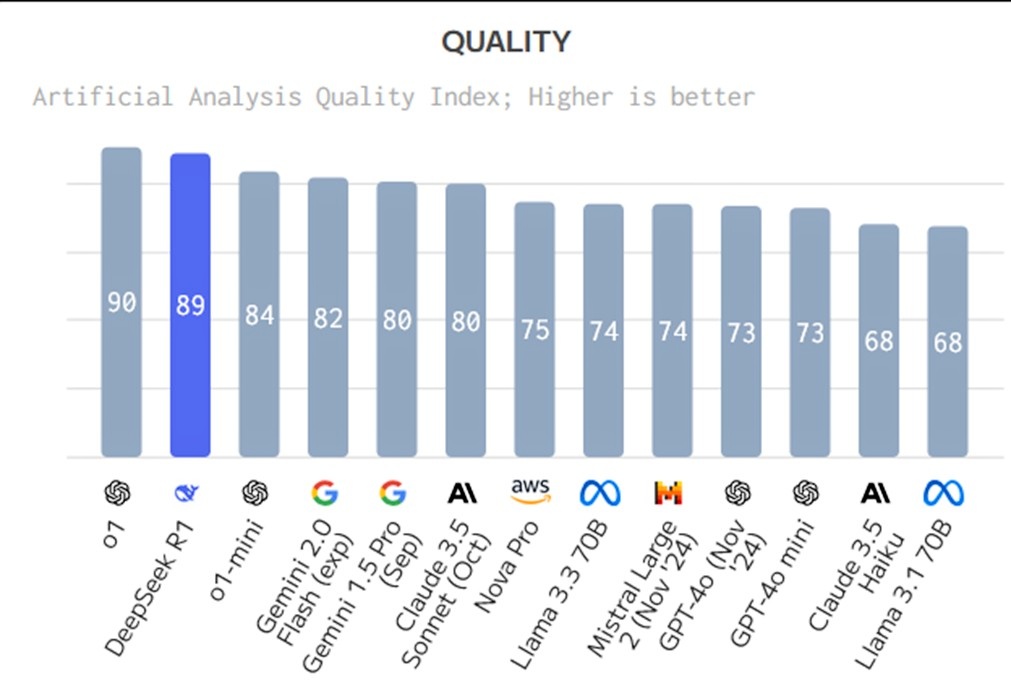

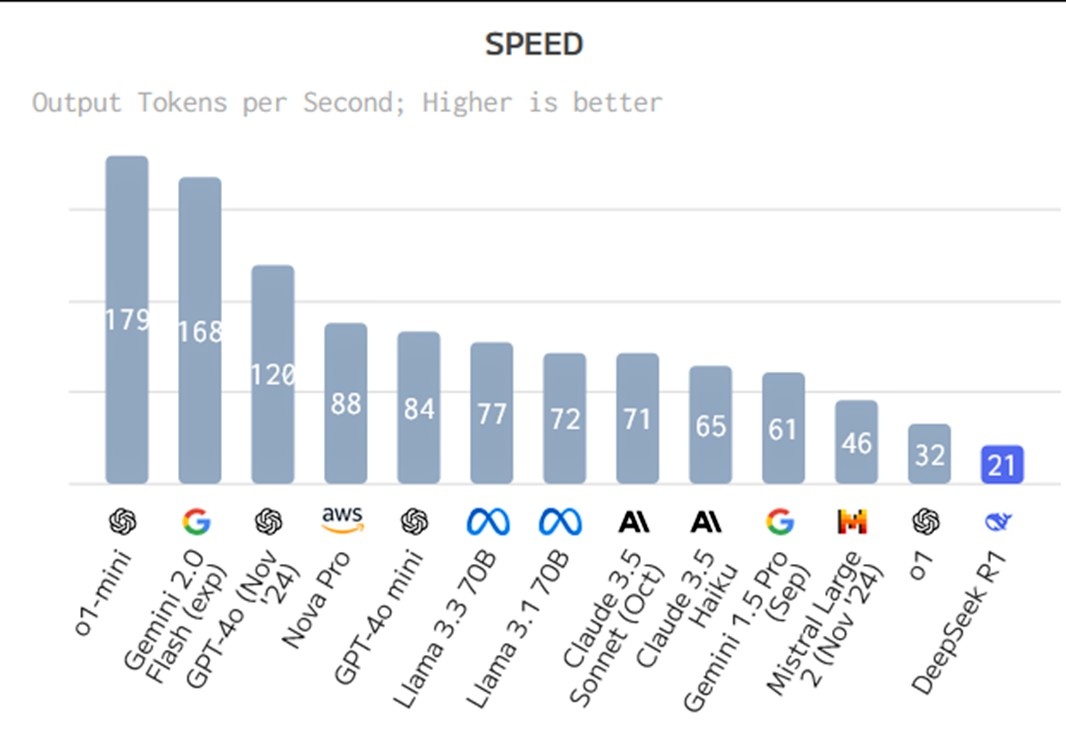

Cena je ale samozřejmě jen jedním parametrem, druhým, významným, je efektivita (úspěšnost, správnost odpovědí) a pominout nelze ani rychlost. Jak jsou na tom oba produkty z těchto pohledů? Na začátek si řekněme, že srovnání modelů AI je náročné a vydalo by na mnoho vědeckých prací, záleží na zaměření LLM a na sestavě otázek a jejich vyhodnocení.

Pokud se podíváme na výzkumy, tak lze říci, že oba modely jsou si výsledky velmi podobné.

Z dostupných výsledků je patrné, že kvalita výstupů je podle analýzy srovnatelná, pouze v rychlosti DeepSeek R1 zaostává. Nicméně při faktoru mnohem nižší ceny jde o akceptovatelnou vlastnost.

Omezení a problémy

DeepSeek AI však má také svá omezení - spadá pod čínskou legislativu se vším, co k tomu náleží. Z pohledu výsledků se jedná o cenzuru: vše, co není v souladu s čínským pohledem na svět, je v modelu nepřístupné. Zkuste se ho například zeptat na Tchaj-wan. Otázkou tedy je, jak v budoucnu bude model „odladěn" a jak moc budeme moci věřit jeho výstupům.

Zároveň je model trénován na čínských serverech, což je další argument, se kterým se budeme muset vyrovnat. Ochrana soukromí a dat bude zcela jistě předmětem spekulací a dohadů.

Skutečný převrat?

Máme tedy k dispozici model s velmi výhodnou cenou, velmi dobrou kvalitou, byť prozatím s nižší rychlostí. Trhy na něj reagovaly velmi silně a pohyb akcií některých firem byl masivní. Nervozita investorů byla dána panikou, že jejich velké investice do současných LLM jsou znehodnoceny, neboť DeepSeek AI dokázala vytvořit podobný LLM na slabším hardwaru za zlomek financí.

Destilace

Ne, nebudeme vyrábět domácí alkohol. Destilací se v oboru LLM rozumí využití existujícího modelu k tréninku nového. Výhodou tohoto postupu je rychlost a nízké náklady na nový model. Během destilace se využije velký vytrénovaný model (teacher) k vytvoření nového modelu (student). Ten pak sdílí většinu schopností a kvalit původního modelu a umožňuje například jeho specializaci.

Jak to vše dopadne?

Uvidíme, jaké bude další pokračování této zajímavé situace. Máme ChatGPT jako etablovaný model a novinku, která nasadila agresivní cenovou politiku a u které existuje podezření na využití již existujícího modelu k vytvoření konkurence za nízkých nákladů.

Alexandr Vasilenko, školitel AI technologií ve středisku OKškolení společnosti OKsystem